The Red : 김형진의 LLaMa3 & 오픈소스 LLM을 활용한 Fine-tuning & AI 서비스 구현

오픈소스 LLM을 활용한 고급

Fine-tuning & AI 서비스 구현

김형진

김형진

현) Databricks, Staff Software Engineer (ML)

전) Uber, Staff Software Engineer

전) Linkedin, Data scientist

LLM 새로운 지각 변동, Meta AI 의 Llama 모델

LLM 개발 전문가 김형진의

Llama3 & 오픈소스 LLM 마스터 클래스

LLaMa의 등장은 LLM 시장에 새로운 지각변동을 일으키며,

오픈소스 LLM의 차세대 아이콘으로 급부상하고 있습니다.

강의를 통해 개발자, 데이터 사이언티스트, AI 엔지니어에 이르기까지

다양한 직무 경험을 토대로 풀어내는 김형진 강사님만의 인사이트를 가져가세요.

수 많은 기업의 강연요청을 뒤로하고,

지금 패스트캠퍼스에서 단.독.공.개.합니다.

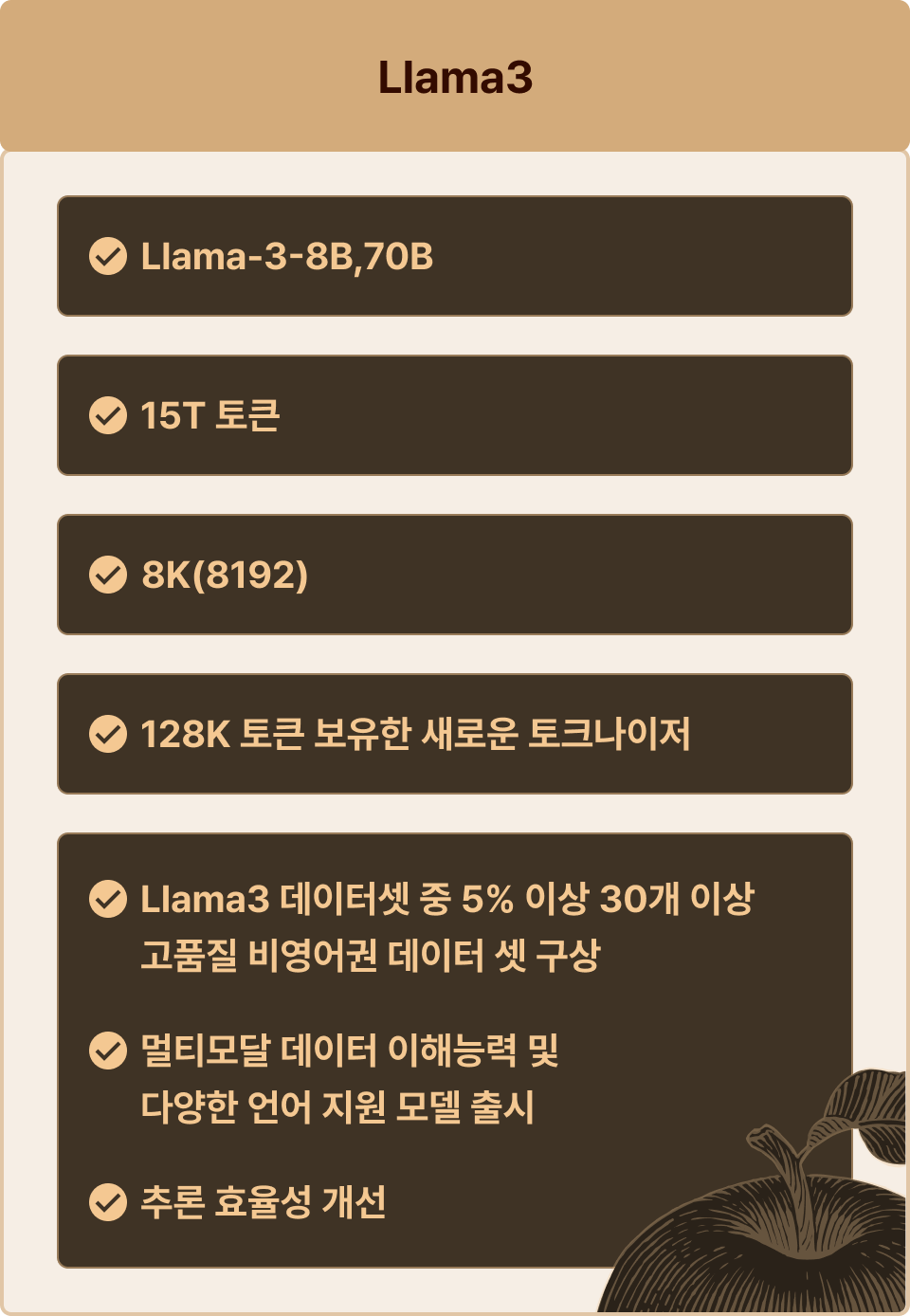

LLM 시장에 새로운 지각변동을 일으킨 META의 라마(Llama) 모델의 발전과정과 함께 가장 최신 모델 라마(Llama)3 모델 집중적으로 배워보기

라마(Llama)3 모델을 활용하여 언어모델 학습과 AI Application 개발을 위한 고급 Fine-tuning 과 프롬프트 엔지니어링 노하우 학습과 깊이 있는 실습해보기

GPT 같이 이미 성능이 입증된 Closed Source 모델을 사용하는 대신 Open Source 모델을 사용 해야 하는 이유를 비교해보고 AI application 개발에 활용하기

보안, 확장 등을 고려하여 라마(Llama)3 모델용 API를 통해 모델 서빙부터 환경에 맞는 맞춤형 AI application 구축까지 직접 해보기

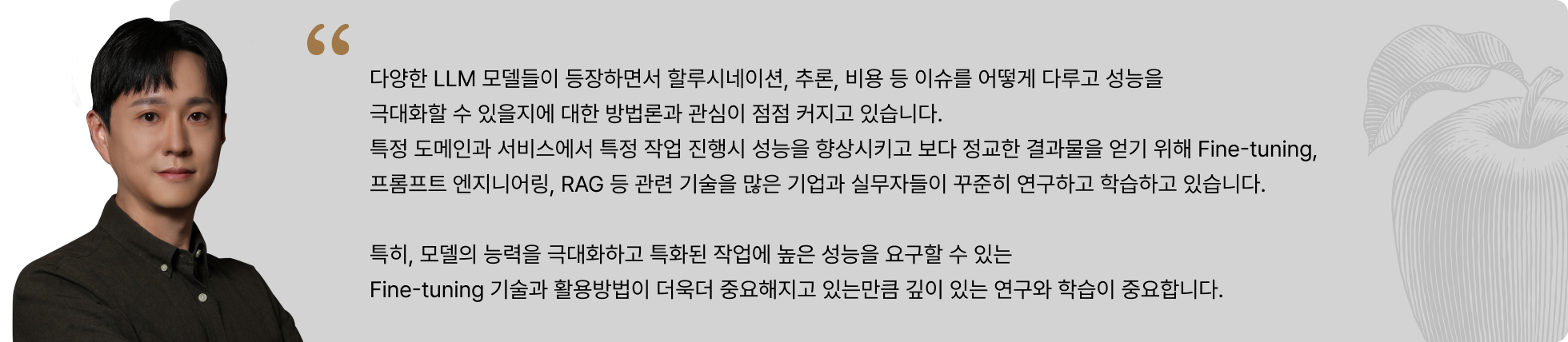

AI 의 최전선인 실리콘밸리에서, LLM 시장을 뒤집어놓은

라마(Llama) 3 모델을 깊이있게 파헤쳐보고 오픈소스 LLM을 활용하여 고급 파인튜닝과 AI Application 개발을 위한 LLM 활용법 노하우를 나누고자 합니다.

LLM 의 최전선에서 겪은 시행착오와 노하우를 바탕으로

Llama3를 포함한 오픈소스 LLM을 활용하려는 분들을 위한 파인튜닝 조언, 서비스에 오픈소스 LLM을 도입하고자 하는 분들을 위한 아키텍처 기본 구성,

그리고 Llama를 포함한 여러가지 오픈소스 LLM 활용법과 히스토리까지

LLM 사용의 어느 단계에 계시든, 이 내용이 큰 도움이 되실 것입니다.

by. 김형진 (Databricks, Staff Software Engineer)

“Llama3 는 어떤 모델이고 왜 주목 받고 있나요?”

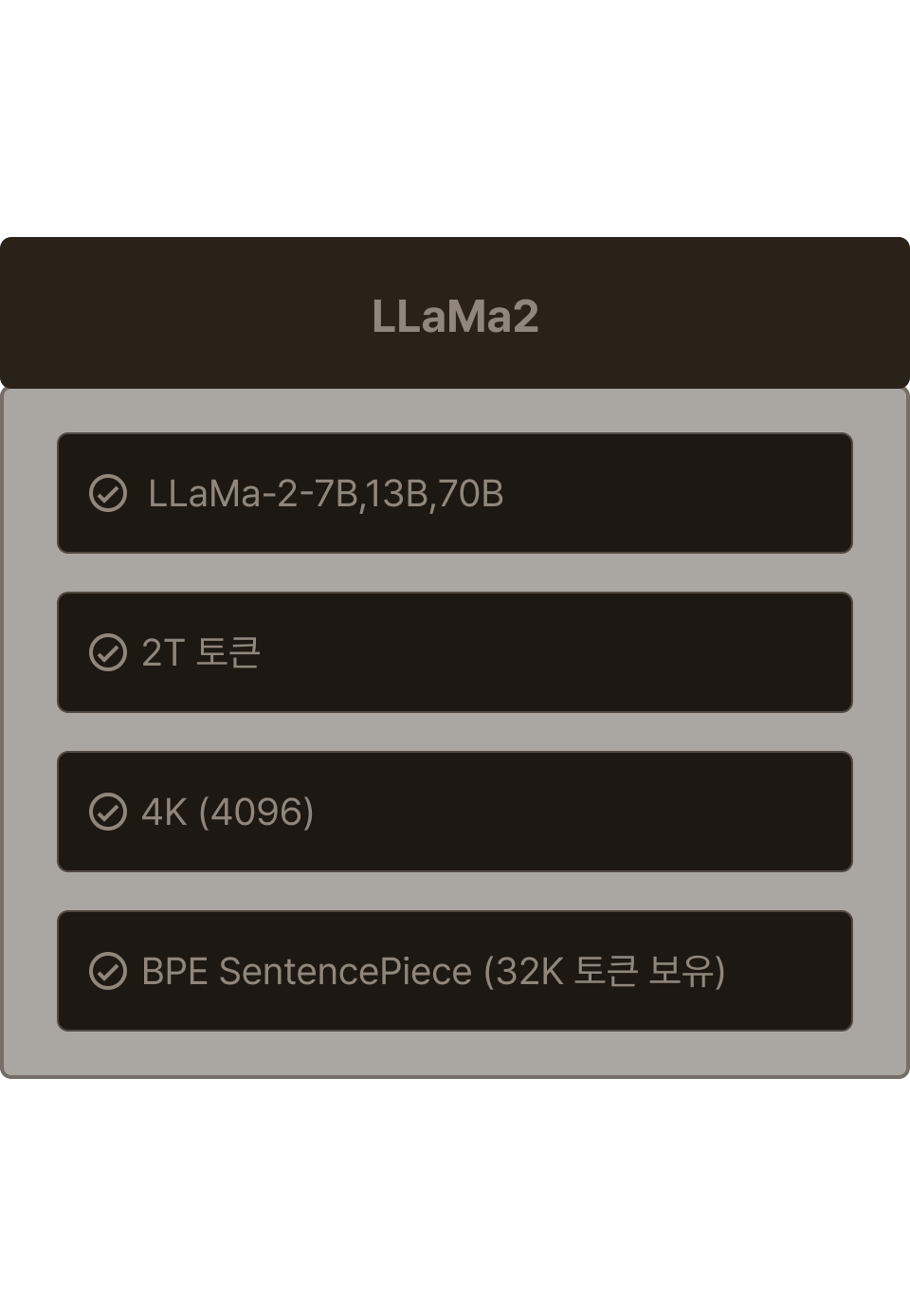

Llama3는 Meta AI 에서 연구개발한 모델로 2023년 첫번째 모델을 시작으로

70억에서 650억 파라미터에 이르는 다양한 모델 크기가 학습 되었으며, 오픈소스 형태로 제공되어

향상된 추론, 미세조정된 언어 이해, 새로운 기능 등을 통해 다양한 분야에서 좋은 성능을 제공하는 언어모델

환경, 특성에 맞는 LLM 기반 AI 서비스를 구축하고 LLM 을 잘 활용하기 위해서는

오픈소스 LLM의 특성과 한계를 보완하기 위한 방법을 깊이 이해하는 것이 중요합니다.

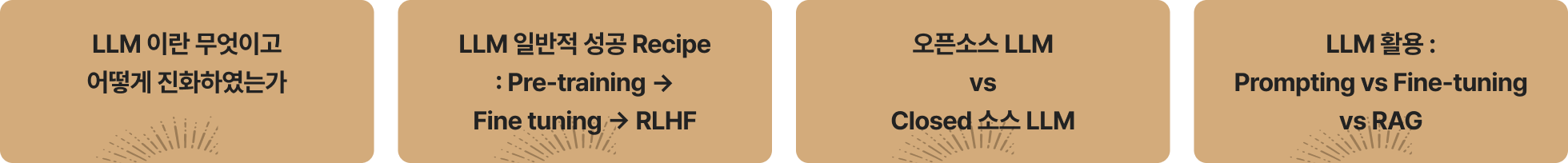

Overview

최적화 된 AI 서비스 구현을 위한 오픈소스 LLM인

Llama3을 활용한 Fine-tuning 마스터클래스

오픈소스 LLM의 대표주자 Meta AI 의 LLaMa3 모델을 더욱 잘 이해하고 사용할 수 있도록 Llama3 모델의

핵심개념부터 Llama3 모델을 활용한 고급 Fine-tuning과 활용 노하우까지 한번에 배워봅니다.

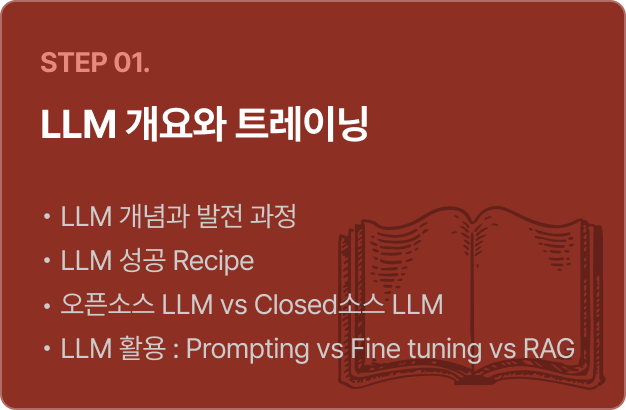

1. LLM & Llama 모델 핵심

2. 성능 향상을 위한 고급 Fine-tuning

3. Llama3 활용한 AI Application 개발

4. Llama 3.1 등장

Basic

오픈소스 LLM 에 대한 이해와 함께

Llama3 핵심 개념과 성능

집중적으로 파헤쳐보기

오픈소스 LLM 선두주자 Llama3 모델의 핵심개념과 함께

다양한 언어모델 비교분석으로 LLM 에 대해 한층 깊이 있게 이해해봅니다.

Intro to LLM

Llama3 집중 분석

Fine-tuning

Databricks, Uber, Linkedin 경험한 AI 개발 전문가 김형진님의

진한 인사이트가 담긴

LLM Fine-tuning 이해와 실습

LLM기반의 Fine-tuning 기초부터 심화까지. 예시 데이터를 활용하여 Supervised Fine-tuning을 진행해보고,

Llama3 모델에 대한 이해를 통한 모델 Training 기초를 학습해봅니다.

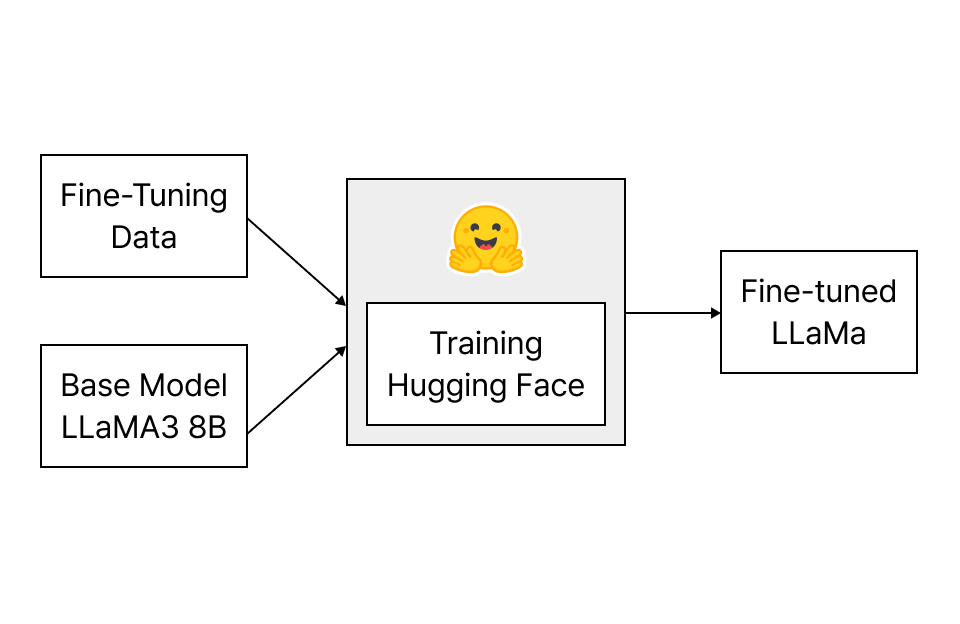

01

Fine-tuning 실전 - 일단 한번 실행해보기

| 핵심 기술 키워드#Open LLM #Hugging face #Fine-tuning #Supervised#Token management #Transforemr #GPU #CUDA

| 학습 내용∙ 데이터 비용, 보안, 성능문제 해결을 위한 Fine-tuning 기초를 살펴보고 8B Llama 모델과 예시 데이터를 활용하여 Supervised Fine-tuning실습을 진행해봅니다.

∙ Fine-tuning 실습을 위해 반드시 알고가야할 핵심 개념인 Huggingface와 GPU, CUDA 와 함께 다양한 Library 를 살펴봅니다.

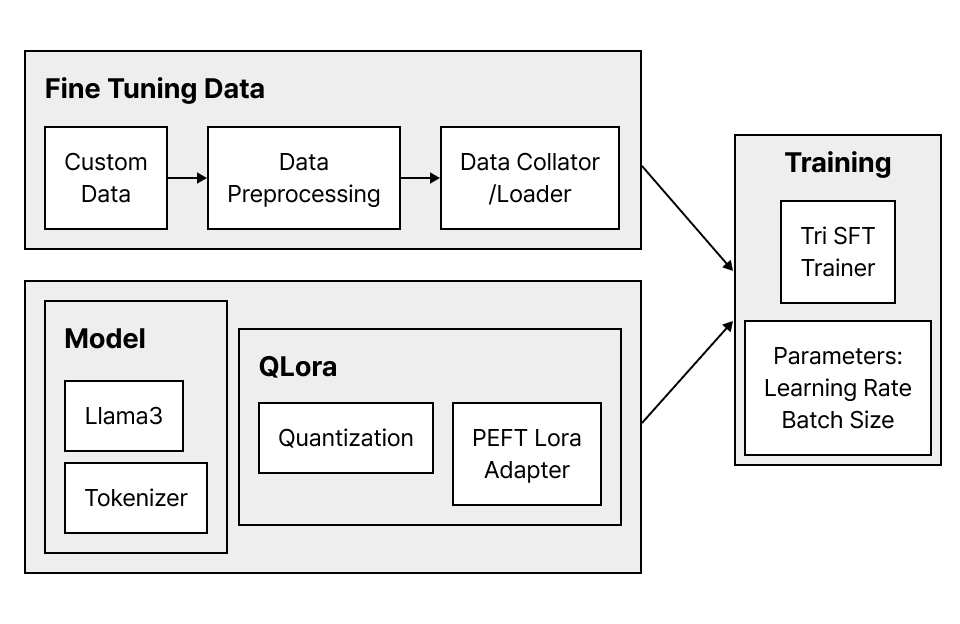

02

Fine-tuning in Depth (고급 파인튜닝)

| 핵심 기술 키워드#Tokenizer #Quantization #LORA #Gradient Descent #Back Propagation #Learning Rate

| 학습 내용∙ Llama3 코드 로딩 해서 모델 구조를 살펴봅니다.

∙ 고급 Fine-tuning 을 위해 LLM 기초가 되는 Tokenizer 와 최적화를 위한 Quantization, LORA 기법 등을 이해합니다.

∙ Gradient Descent, Back Propagation, Learning Rate 등Training 기초에 대해 배워봅니다.

03

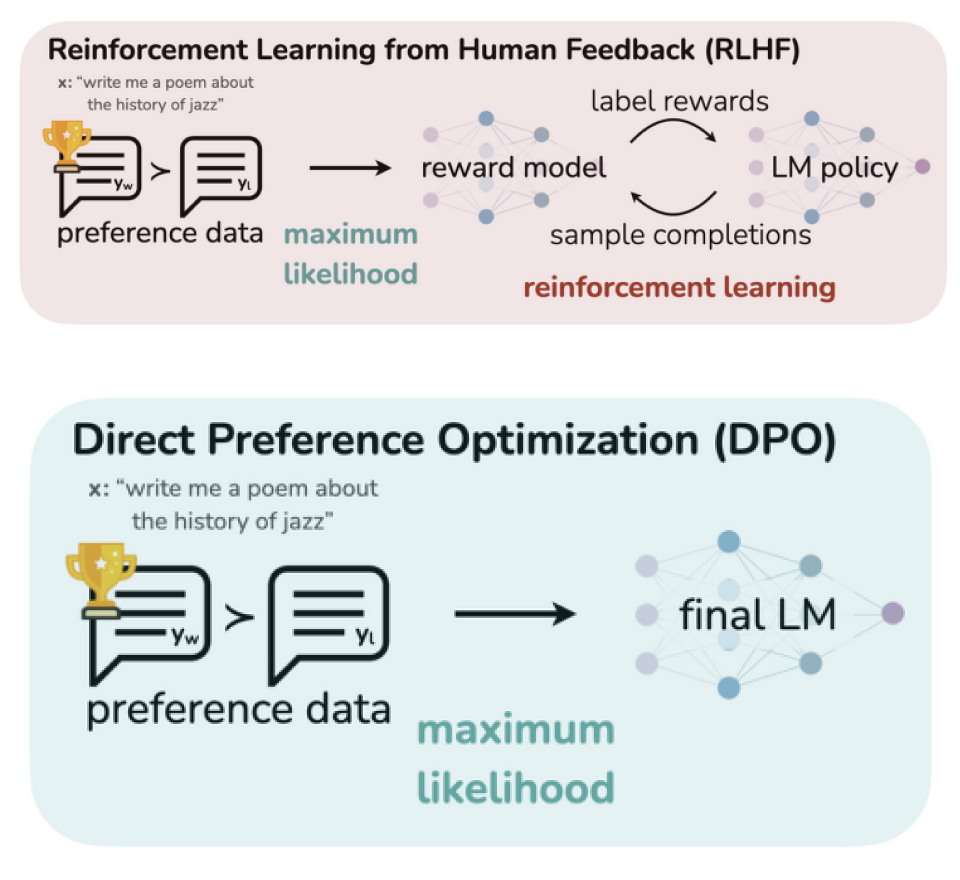

DPO & RLHF

| 핵심 기술 키워드 #RLHF #DPO #강화학습 #Training data

| 학습 내용 ∙ 강화학습을 적용하여 사람 의도에 맞게 Reward 학습 후 파인튜닝하는 RLHF 와 Reward 학습 없이 바로 Preference data로 모델 최적화를 하는 DPO 를 비교해보고 DPO training data 를 준비해서 직접 적용해봅니다.

AI 서비스 실행

실제 AI 프로덕트 도입에 필요한

Llama 활용법으로 구현해보는 LLM AI 서비스 구현

LLM기반의 AI Application 개발을 위해 LLM 모델을 평가하고 데이터를 모아봅니다.

이를 통해, Fine-tuning 과 DPO 를 거친 LLM 모델을 바탕으로 VLLM & Colab 을 통해 직접 AI 서비스로 실행해봅니다.

모델 평가부터 데이터 구하기까지 직접 진행해보며 Fine-tuning으로 최적화된 서비스를 직접 만들어보는 실습을 진행해볼 수 있습니다.

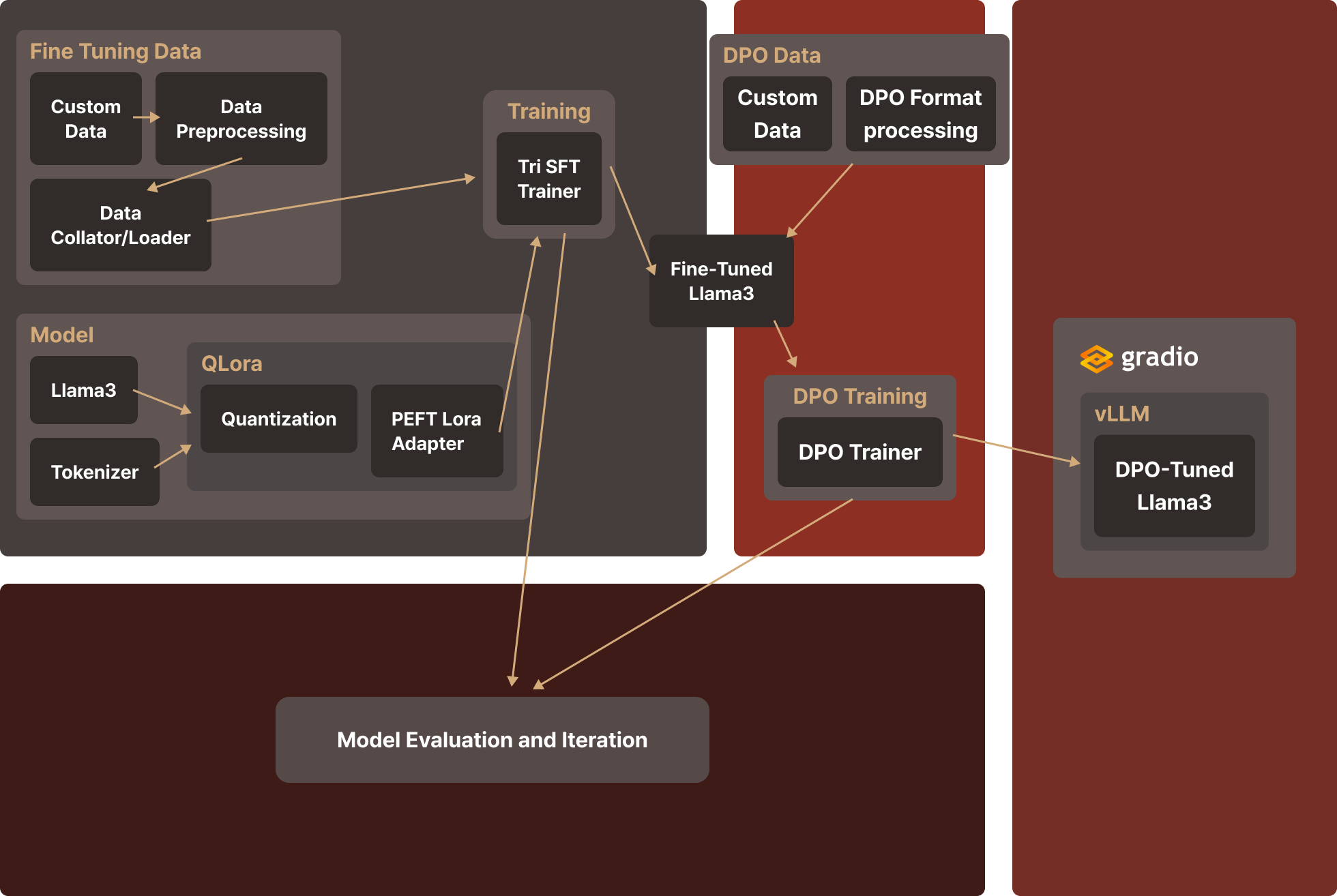

AI 서비스 구현을 위한 Fine-tuninig 파이프라인

고급 Fine-tuning을 위한 모델 최적화

처리량은 높이고 비용 줄여주는 라이브러리 vLLM 에 대해 함께 살펴본 후,

Fine-tuning 과 DPO 를 거친 LLM 을 활용하여 vLLM 라이브러리를 통해 실제 AI 서비스를 실행해봅니다.

Special Update

Llama3 에 뒤이어 새롭게 출시된 Llama3.1 모델

가장 강력한 오픈소스로 불려지는 Llama3.1 모델 리뷰하기

더 많은 데이터로 학습되어 더 크고 강력한 모델로 진화한 Llama3.1

Llama3.1 출시가 가지는 의미와 함께, Llama 3.1를 바탕으로 Fine-tuning 과 서비스 제작을 진행하며

Llama3와 달라진 점에 대해서 함께 살펴봅니다.

Top of Top

전 세계 LLM 개발 연구 선두자이자 UBER & Linkedin 출신

Databricks, Applied AI Team Staff Engineer

김형진

인공지능, 데이터 분야 글로벌 선두기업, 데이터브릭스 Applied AI 팀 김형진의 실전 Fine-tuning 강의

현재 데이터브릭스의 Applied AI 팀에서 실 Product에 LLM을 녹여내는 일에 몰두하고 있습니다.

Applied AI팀의 설립 멤버로, 다양한 활용 사례를 겪으며 LLM을 특정 도메인에 특화되도록 fine-tuning 하는 등 AI 기반의 제품을 개발하는데 필요한 다양한 지식을 습득 할 수 있었어요. 이 강의에서는 ‘Llama3를 포함한 오픈소스 LLM ’ 부터 ‘LLM 개발 기초’, '오픈소스 LLM활용', '모델 튜닝 및 평가'에 이르기까지, 오픈소스 LLM을 기업 환경에서 효과적으로 도입하기 위해 고려해야 할 핵심 요소들을 다룰 예정입니다.

또한, 실제 프로젝트에서 마주칠 수 있는 도전적인 상황들과 이를 극복하기 위한 실질적인 솔루션도 공유하게 됩니다.

본 강의를 통해 여러분께 제가 실리콘밸리의 빅테크 기업에서 AI 기반의 제품을 개발하며 얻게 된 노하우와 인사이트를 공유드리고자 합니다.

이를 바탕으로 여러분의 프로젝트에 LLM을 효과적으로 적용하는 방법을 마스터할 수 있기를 기대합니다.

실리콘밸리 빅테크 기업에서의 AI 분야 독보적인 경험들을 통해 얻은 강사님만의 인사이트

현재 데이터브릭스 Applied AI 팀의 Staff Software Engineer로 일고 있습니다.

저는 스탠포드 대학에서 Computer science 석사 학위를 취득한 후, 링크드인, 우버와 같은 세계적인 기업에서 다양한 역할을 맡아왔습니다.

링크드인에서는 추천 엔진 팀에서 일했습니다.머신러닝을 기반으로 사용자에게 친구를 추천할 때 버튼을 클릭할 확률을 예측하는 친구 추천 프로젝트 등에서 일하며 인공지능과 데이터의 중요성을 실감하였습니다.

이후, 우버에서는 예측 AI 기술을 기반으로 기반으로 승객과 기사를 어떻게 매칭할지의 효율성을 최적화 하는 일을 하였습니다. 현재 데이터브릭스에서는 Applied AI팀에서 LLM관련 프로젝트에 집중하고 있습니다. AI-generated Data documentation, Code Autocomplete등의 프로젝트를 통해 사용자들이 LLM 의 도움을 통해 더 생산적이 될 수 있도록 하는 데 최선을 다하고 있습니다.

이렇게 다양한 경험을 바탕으로 얻게 된 AI와 LLM에 대한 활용 노하우와 저만의 인사이트를 최대한 이 강의에 담아 여러분들께 전달드리고자 합니다.

• 2023: Viva Republica: 머신러닝에서 AI까지: 세상을 바꾸는 데이터 프로젝트들

• 2022: 링글 글로벌 컨퍼런스: 스탠포드 유학, 그리고 미국 취업: AI/ML 엔지니어의 삶과 커리어

• 2022: 서울대학교 계산사회과학 입문 : AI and things to think about

• 2018: 실리콘 밸리의 한국인들: 세상에 임팩트를 주는 엔지니어

• 2017: Youtube[EO Channel]:이 영상 하나로 '인공지능', '딥러닝'을 이해할 수 있다 199k view

• 2016:현대카드: 어제의 데이터를 통해 내일을 예측한다

• 2016: Data By The Bay: Black Magic: How to apply Machine Learning to real-world problems

• 2014 Deview: LinkedIn의 Data Science - 왜 '과학'인가?

• 2013 Deview: 링크드인의 Big Data Recommendation Products

To-be

Llama3를 활용한 Fine-tuning

& AI 서비스 개발

본 강의를 수강한 뒤

여러분들은 이렇게 바뀌게 됩니다.

고급 파인튜닝 기법을 구사하고, 맞춤형 AI 서비스 개발할 수 있습니다.

서비스 도입 및 운영 과정에서 마주치는 문제 해결 역량을 강화할 수 있습니다.

다양한 업무 영역에 LLM 을 제대로 활용할 수 있습니다.

자신만의 AI 프로젝트를 구현하여, 이를 통해 새로운 기회의 문을 열 수 있습니다.

추천 수강생

FAQ

이 모든 것이 평생 소장

필요할 때 언제든 변치 않는 인사이트를 꺼내보세요.

상세 커리큘럼

아래의 모든 강의를 초격차 패키지 하나로 모두 들을 수 있습니다.

지금 한 번만 결제하고 모든 강의를 평생 소장하세요!